Ich würd dir gerne deine Angst nehm’n, alles halb so schlimm

Einfach sagen, diese Dinge haben irgendein’n Sinn

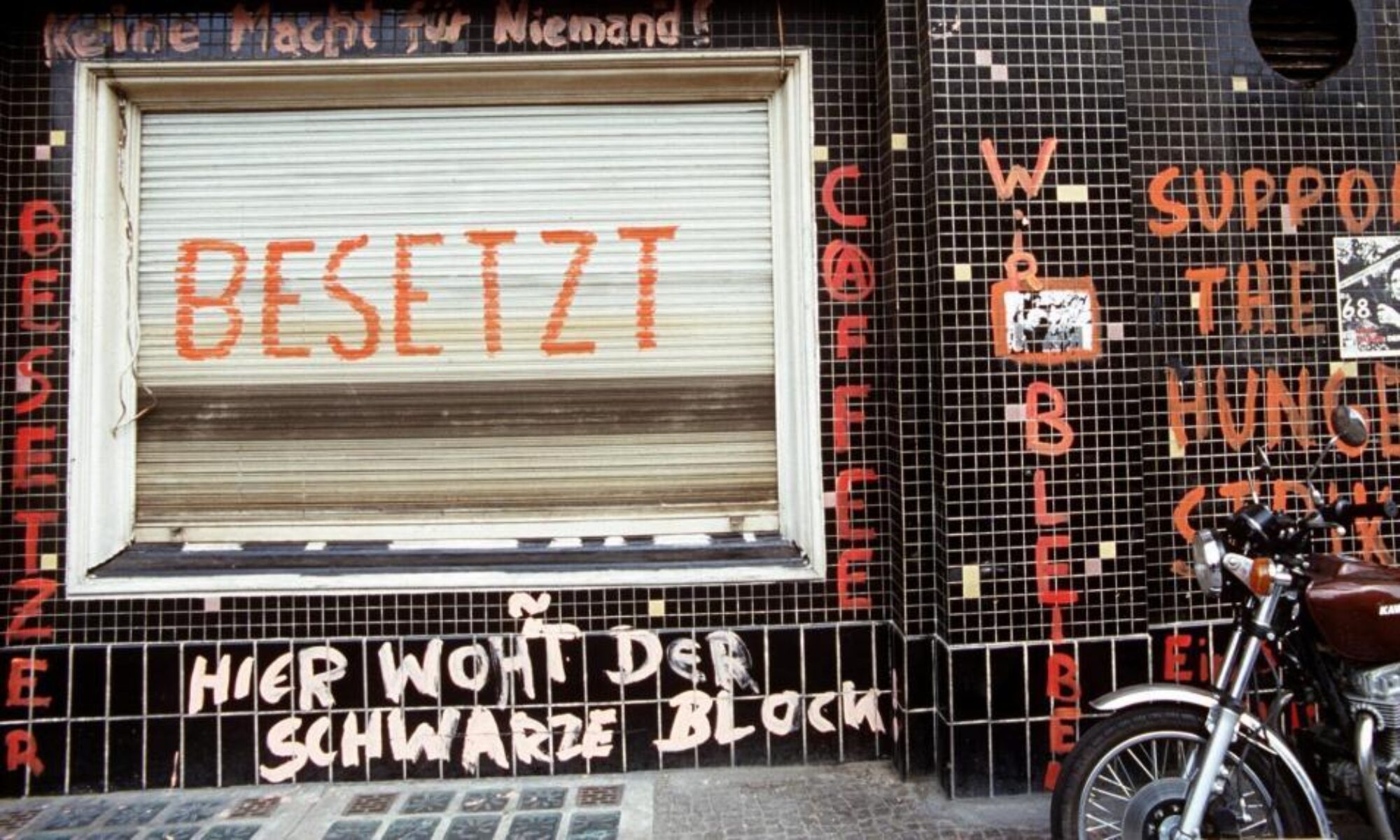

Doch meine Texte taugten nie für Parol’n an den Wänden

Kein’n Trost spenden in trostlosen Momenten

Die Menschen sind schlecht und die Welt ist am Arsch

Aber alles wird gut

Das System ist defekt, die Gesellschaft versagt

Aber: Alles wird gut

Felix Kummer – Der letzte Song

Viele denken, im Fußball geht es um Titel, um Geld, um Ego und ganz groß rauszukommen. Um all das geht es auch (und nicht so wenig) und trotzdem ist da noch etwas, was unsere Seele berührt. Da sind die manchmal verschütteten Erinnerungen an die Leichtigkeit auf dem Bolzplatz, wenn der Ball an unseren Füßen klebte, jene magischen Stunden, in denen alles, was uns zur Last wurde, sich in einem gnädigen, fernen Nebel verlor. Eine Erinnerung, die sich in jeder unserer Körperzellen eingespeichert hat, und selbst wenn wir gramgebeugt, alt und grau durch die eine Welt schleichen, die uns fremd geworden ist, erinnert sich der Körper in Sekundenbruchteilen, wenn uns unvermittelt ein Ball vor die Füße fällt, den ein Kind versehentlich über den Zaun des Fußballplatzes geschossen hat. Völlig selbstvergessen kicken wir den Ball mit aller Lässigkeit und Grandezza über den Zaun zurück, jener Moment, in denen wir wie Sisyphos aller Absurdität zum Trotz glücklich den Berg hinab schreiten um erneut erneut den Fels zum Gipfel hinauf zu stemmen.

Fußball ist ein Geschäft, ist eine Ware, wie fast alles in dieser unserer schlechtesten aller möglichen Welten. Das Geld der Investoren, die VIP Lounges, die Mauscheleien von FIFA, UEFA und den Clubführungen mit den Diktatoren und Schlächtern der Welt. Aber Fußball ist auch noch immer der Sport der einfachen, der armen Leuten. Seine Magie strahlt immer noch über diesen Globus, in den Favelas und Townships sitzen die Menschen dicht zusammengedrängt in Trikots von Messi und Maradona vor den Fernsehern und schauen die Weltmeisterschaft oder das Finale der Champions League. Für viele arme Kinder ist Fußball der einzige Traum, um ihrem Elend und ihrer Armut, in der sie lebenslang gefangen bleiben werden, doch zu entrinnen. Und so toben sie über staubige Sandplätze und betonierte Käfige in den Banlieues dieser Welt, zittern, bangen und fallen mit ihren Helden, jubeln und feiern deren Erfolge, als wären es die ihrigen. Fußball ist der einzige Teamsport, in dem eine faktisch wesentlich schlechtere Mannschaft einen hoch überlegenen Gegner an einem guten Tag besiegen kann.

„Remontada [Part 1] – Der Große Attraktor“ weiterlesen